reference: ithome - Google更新行動機器學習開發套件ML Kit,不再依賴Firebase雲端開發平臺

Google ML Kit (前身為Firebase ML-Kit)是由Google所開發的機器學習開發套件:

註:由於Google ML Kit是目前新的解決方案,不建議使用Firebase ML Vision sdk;本文撰寫會使用ML Kit,不會使用到任何Firebase的功能,請留意差別

使用套件一定都是要讀官方文件、或是官方Samples。這裡我們就直接使用官方提供的Samples來實際使用看看吧!

下載Google在Github上的ML Kit Vision Quickstart Sample,下載下來後是壓縮檔(.zip),請解壓縮vision-quickstart專案到你喜歡的目錄下

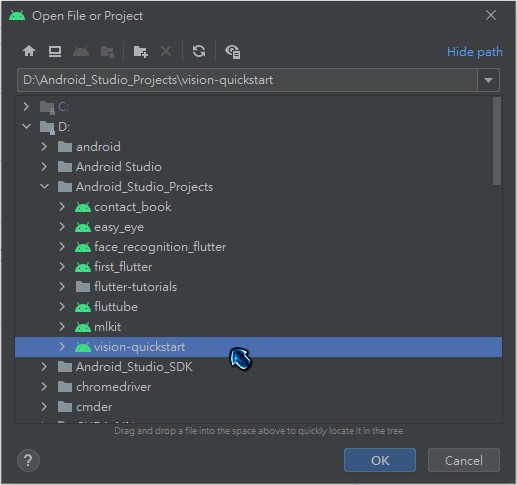

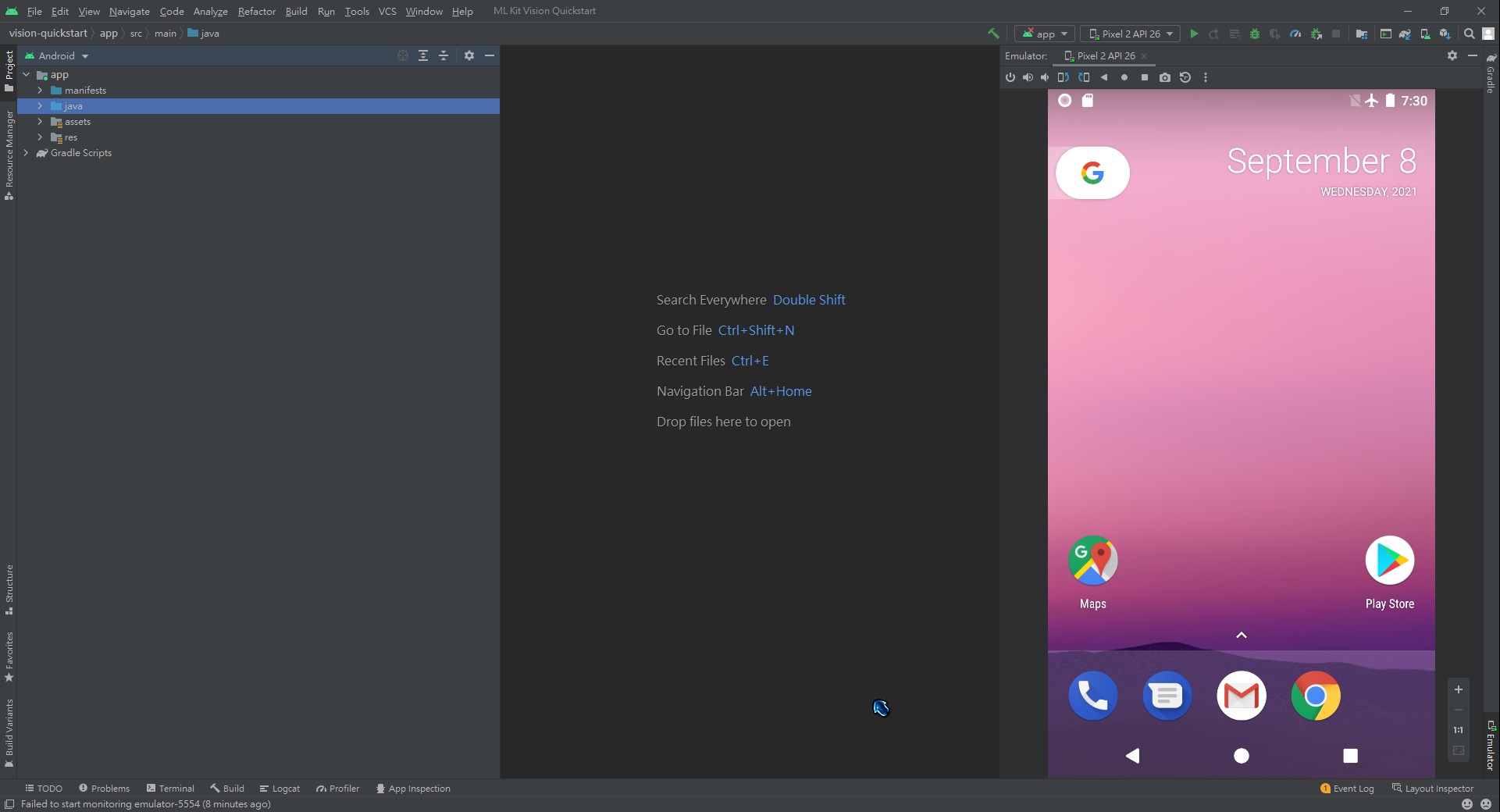

開啟Android Studio,開啟剛才的專案vision-quickstart

開啟之後如果遇到gradle版本與java版本不符或其他錯誤問題,請自行搜尋google或留言在下面,我會儘快回覆

開啟之後會需要等待Gradle進行專案初始化,完成後應該會看到BUILD SUCCESSFUL這個工程師都愛的句子

有關ML Kit sdk的API說明,Google這份文件說的很清楚,這邊只就其中幾個重點提一下:

# com/google/mlkit/vision/demo/java/facedetector/FaceDetectorProcessor.java #47行

detector = FaceDetection.getClient(faceDetectorOptions);

faceDetectorOptions有幾個參數

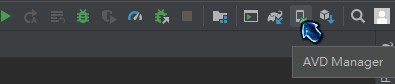

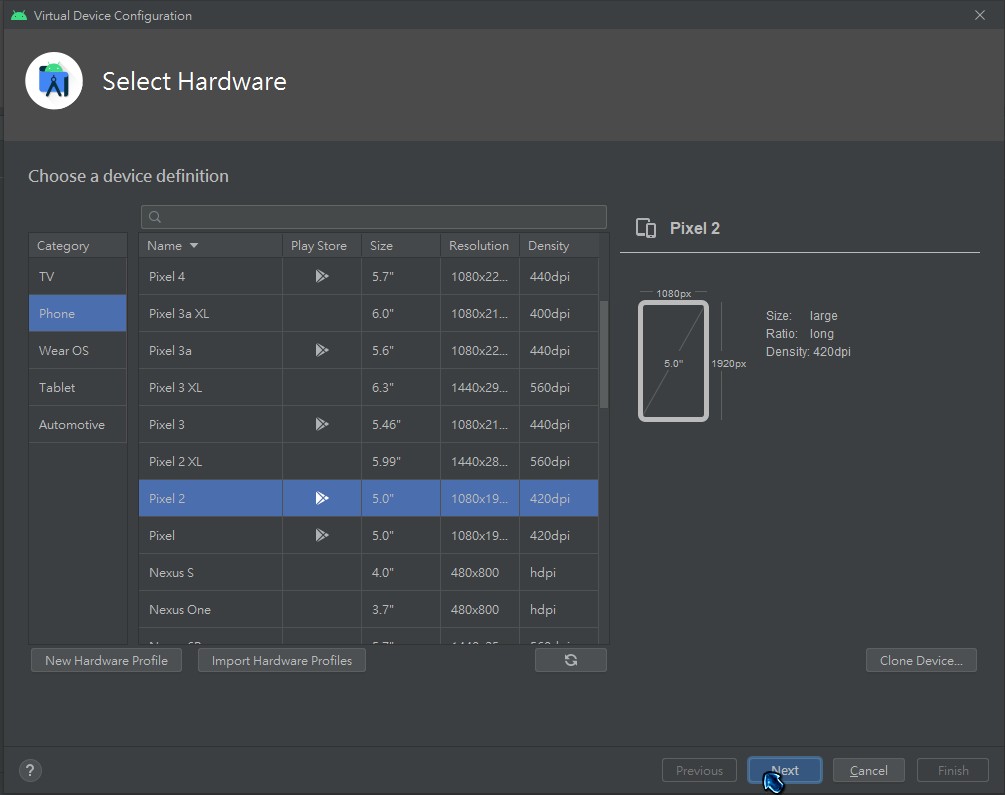

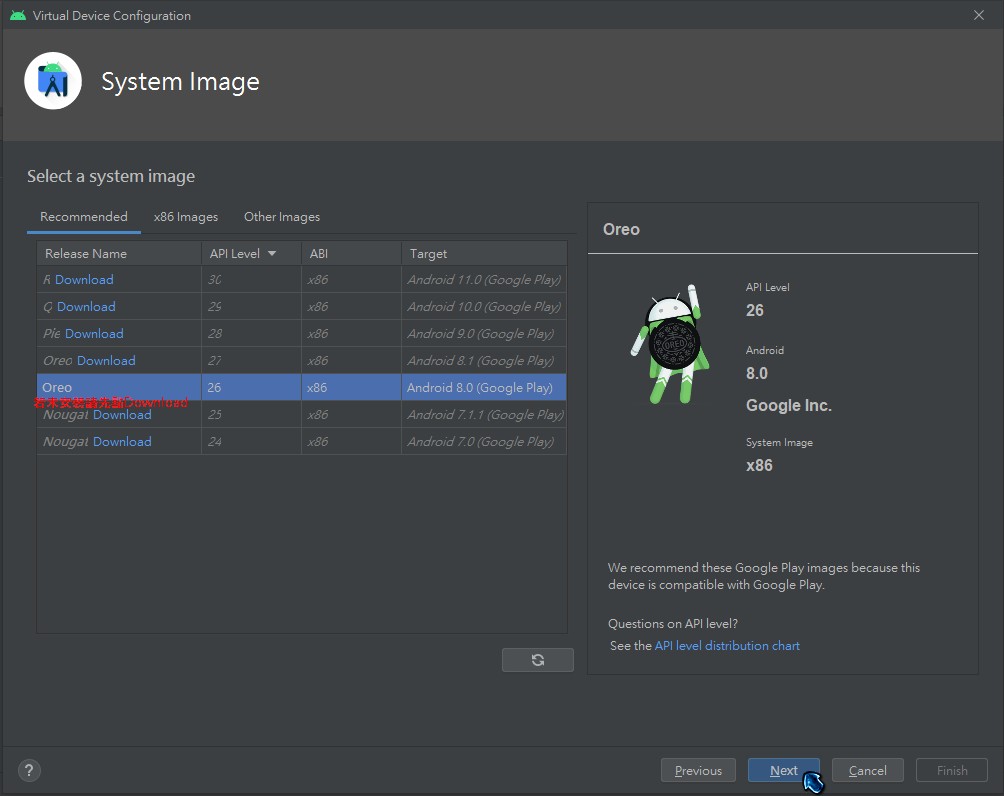

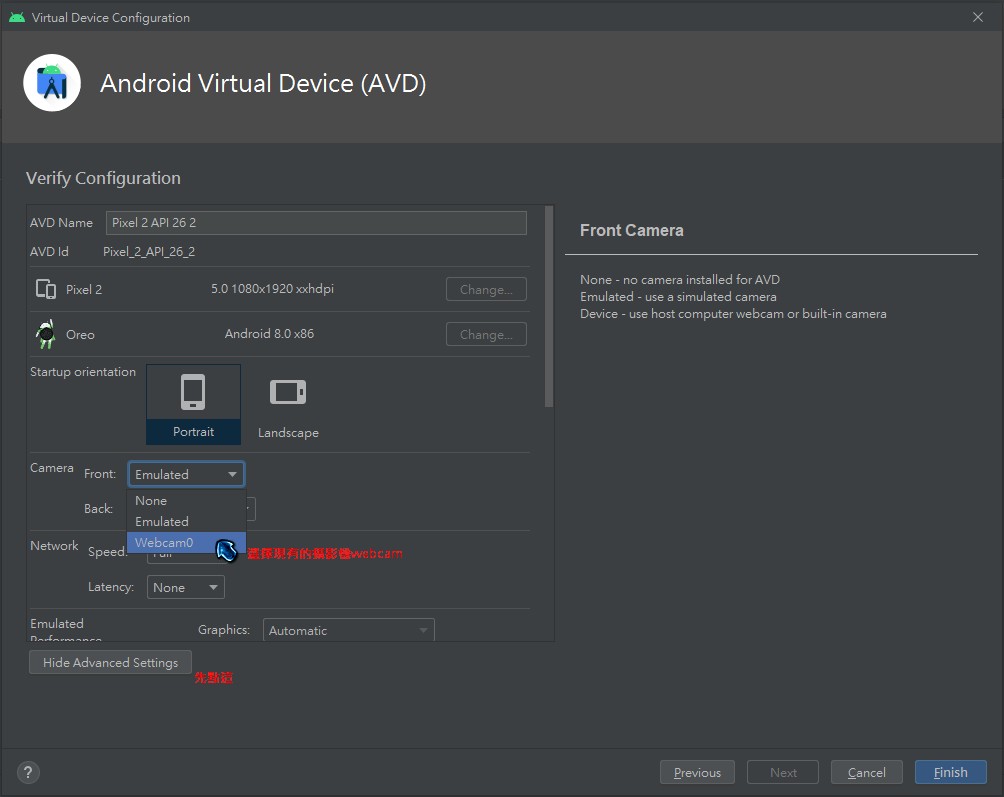

打開右上角的AVD Manager -> 點選跳出視窗左下角的「Create Virtual Device」->選擇Phone、Pixel 2、System image選Oreo(API Level 26),沒有安裝請先點Download、Configuration欄位打開Advanced Settings,選Front=Webcam0這樣才可以使用攝影機

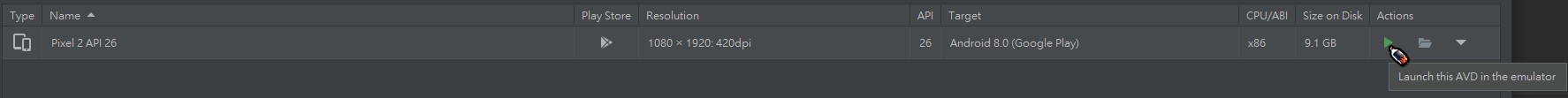

建立完AVD後,點選列表中Pixel 2 API 26旁的啟動按鈕

在主畫面應該會看到模擬器啟動了,接下來讓我們打包App吧!

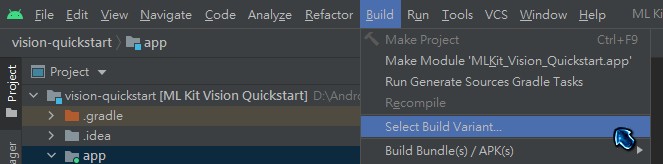

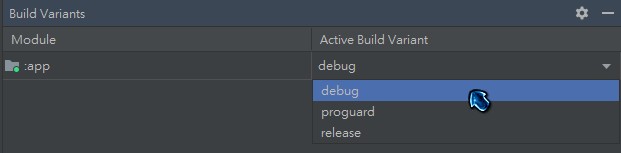

點選主畫面上方的Build -> Select Build Variant,跳出的視窗中,在Active Build Variant選擇debug

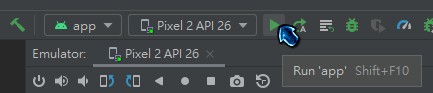

等待Build過程,你可以熟悉一下手機模擬器的一些操作...完成後,請點選右上角的Run 'app'

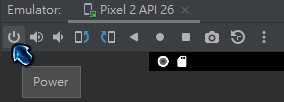

註:如果你的"手機"進入螢幕保護程式(畫面全黑),請點選上方功能列的電源按鈕解鎖即可

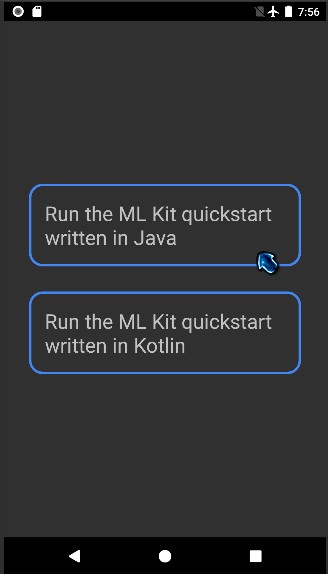

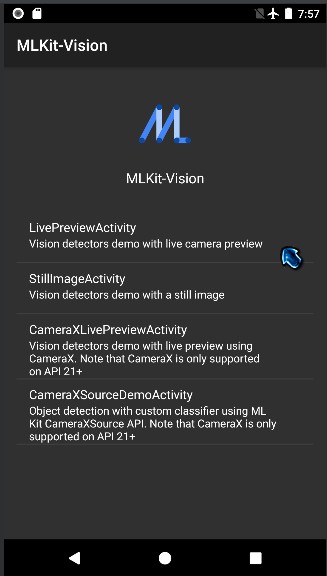

開啟畫面後:

我們用Java版的ML試看看

選擇LivePreviewActivity

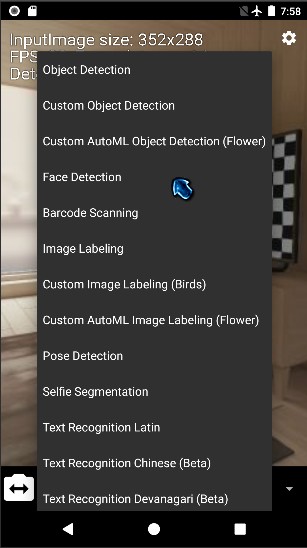

進入畫面後,先選擇Face Detection

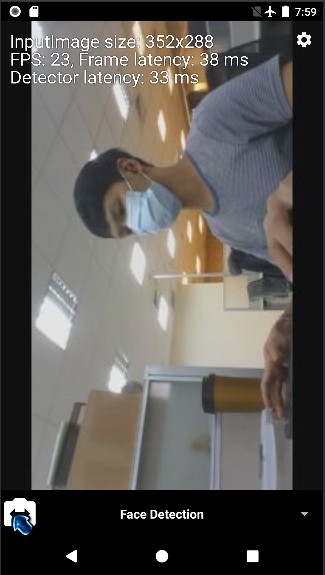

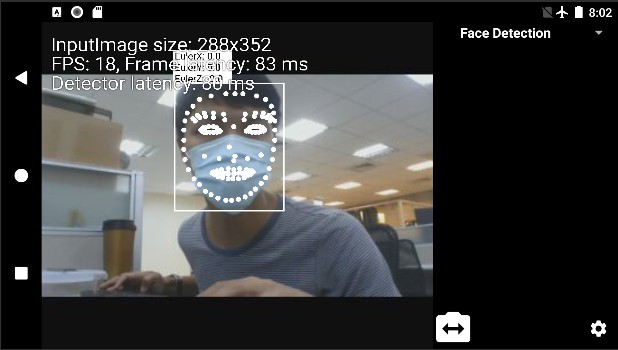

點選左邊的切換鏡頭圖示,如果前面你有開啟設定AVD Emulator的前鏡頭,應該會看到:

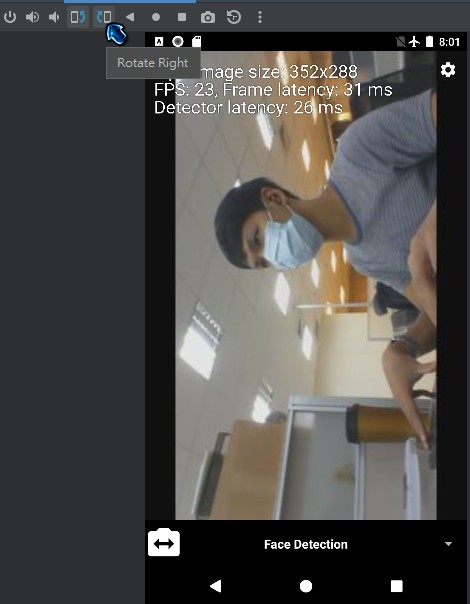

轉一下手機

把你的臉靠近鏡頭,應該會看到你被標示了

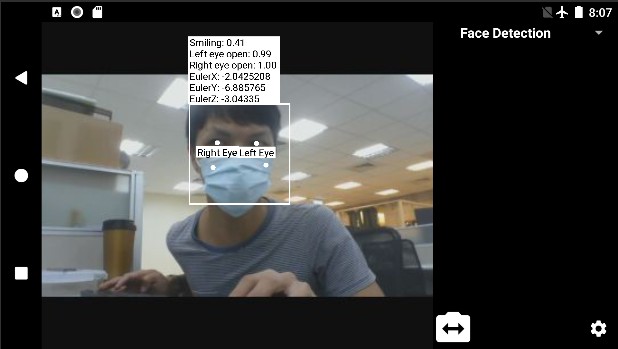

改一下設定(右下角的齒輪圖示):

可以看到戴上口罩也可以成功偵測,Google ML Kit的辨識效果也不差。你也試著玩看看其他設定吧!

如果是使用Mac開發的人就See you tomorrow~